|

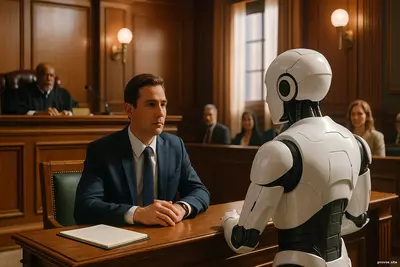

Судебные алгоритмы: когда машину зовут в суд

Правосудие под цифровым прицелом

Юриспруденция всегда ассоциировалась с человеческой фигурой — с судьёй, который выслушивает аргументы, с адвокатом, держащим в руках том законов, с присяжными, смотрящими в глаза подсудимому. Это пространство логики, морали и здравого смысла. Но в век технологий даже правосудие не осталось в стороне от цифровой трансформации.

Во многих странах уже сегодня судебные системы используют алгоритмы для анализа дел, оценки рисков, вынесения рекомендаций и прогнозов. Некоторые решения принимаются с опорой на машинное обучение. Машину начали звать в суд не как участника процесса, а как инструмент правосудия. И это вызывает одновременно интерес, тревогу и множество вопросов.

Что такое судебные алгоритмы?

Судебный алгоритм — это программное обеспечение, которое помогает в процессе правосудия, обрабатывая большие массивы данных о делах, подсудимых, предыдущих решениях, характеристиках преступлений и других факторах. Цель таких систем — повысить эффективность, снизить субъективность и оптимизировать нагрузку на суды.

Примеры таких систем:

-

COMPAS (США) — система, оценивающая риск рецидива преступников.

-

HART (Великобритания) — алгоритм, прогнозирующий поведение задержанных.

-

Risk of Recidivism Tool (Канада) — помощь судьям в принятии решения об освобождении под залог.

-

Предиктивные системы в Китае — анализируют правонарушения, предлагая автоматические меры воздействия.

Они используются в разных стадиях — от предварительного ареста до вынесения приговора и условно-досрочного освобождения.

Как работают алгоритмы в правосудии?

В основе большинства судебных алгоритмов — модели машинного обучения, обученные на исторических данных. Алгоритм анализирует информацию о подсудимом: возраст, пол, криминальное прошлое, тип преступления, поведение, район проживания и даже образование.

Затем система выносит оценку риска — например, вероятность повторного правонарушения. Эта оценка может повлиять на:

Иногда алгоритм выносит рекомендации, а иногда — фактически формирует решение, особенно в административных или массовых делах.

Аргументы в пользу алгоритмов

Сторонники алгоритмизации судебной системы приводят целый ряд аргументов:

1. Быстрота

Суды перегружены. Алгоритмы помогают обрабатывать тысячи дел быстрее, снимая рутину и высвобождая время для сложных дел.

2. Последовательность

Машина не страдает от усталости, плохого настроения, предвзятости. Она действует по заданным критериям, обеспечивая стабильность решений.

3. Предсказуемость

Судебная система должна быть прозрачной. Алгоритмы позволяют стандартизировать решения, делая их более понятными и ожидаемыми.

4. Борьба с субъективностью

Алгоритмы, по мнению их создателей, помогают снизить влияние человеческих факторов — симпатий, стереотипов, давления общественного мнения.

Где начинаются проблемы?

Несмотря на высокие ожидания, судебные алгоритмы оказались далеко не нейтральными.

1. Алгоритмическая предвзятость

Алгоритмы учатся на исторических данных — а значит, перенимают все ошибки и предубеждения, существующие в обществе. Например, в США было выявлено, что система COMPAS чаще предсказывает рецидив для темнокожих подсудимых, чем для белых — при равных обстоятельствах.

Так возникает цифровая дискриминация, замаскированная под «объективную оценку».

2. Отсутствие прозрачности

Многие алгоритмы являются проприетарными, то есть коммерчески закрытыми. Судьи, адвокаты и обвиняемые не знают, как именно система пришла к выводу. Это противоречит принципу открытого правосудия: невозможно оспорить то, что непонятно.

3. Чрезмерное доверие

Судья может слишком полагаться на рекомендации алгоритма, особенно если система официально утверждена и выглядит «научно». Это снижает личную ответственность и превращает решение в техническую процедуру, а не моральный акт.

4. Риск лишения человечности

Суд — это не только закон, но и контекст, мотивы, раскаяние, обстоятельства. Алгоритм не чувствует и не сочувствует. Он оперирует числами. Это может привести к обезличиванию судебной системы.

Этика и закон: кто кого регулирует?

Использование алгоритмов в судах поднимает фундаментальные правовые и этические вопросы:

-

Можно ли доверять машине право решать судьбу человека?

-

Кто несёт ответственность за ошибочное решение — судья, компания-разработчик, государство?

-

Должны ли обвиняемые иметь право требовать объяснения алгоритма?

-

Как обеспечить равенство перед законом, если алгоритмы работают по разным принципам в разных юрисдикциях?

Пока мировое сообщество не пришло к универсальному решению. В некоторых странах использование алгоритмов ограничивается. В других — активно расширяется.

Человек и машина: возможен ли союз?

Самый реалистичный путь — гибридная модель, в которой алгоритм становится помощником, а не судьёй. Он может:

Но окончательное решение должно принимать человек, способный учитывать уникальность каждого дела. Именно здесь возникает новая фигура — судья нового времени, который умеет работать с технологией, но сохраняет человечность.

Примеры внедрения и противостояния

Китай

Китай внедряет алгоритмы в судебную систему на всех уровнях. Некоторые дела решаются без участия человека — особенно в административной сфере. Цель — скорость и эффективность. Но это вызывает опасения у правозащитников.

США

В США алгоритмы используются в отдельных штатах. Но скандалы вокруг COMPAS привели к активному обсуждению запрета или строгого регулирования таких систем.

Европа

В странах ЕС подход более сдержанный. Основное внимание уделяется этичности, прозрачности и права на объяснение, особенно в свете закона GDPR.

Что дальше?

В ближайшие годы нас ждёт рост использования искусственного интеллекта в правосудии. Но это потребует:

-

создания открытых и проверяемых алгоритмов;

-

международных стандартов этики и прозрачности;

-

подготовки специалистов, способных критически оценивать выводы систем;

-

законодательства, которое не позволит машинам заменить моральное суждение.

Судебная система — это нерв правового государства. Она не должна превращаться в набор чисел. Но и отвергать помощь технологий — значит игнорировать потенциал точности, скорости и объективности.

Заключение: справедливость — не алгоритм

Машины могут помогать, но не могут чувствовать. Алгоритмы могут предсказывать, но не понимать. Правосудие требует не только знаний, но и мудрости, сострадания, ответственности. В этом смысле будущее судов — не в замене человека, а в его усилении через разумное использование технологий.

Когда машину зовут в суд, она должна быть свидетелем, но не судьёй. Потому что только человек способен взвесить не только факты, но и ценность человеческой жизни, которая за ними скрыта.

|